來源:資料STUDIO作者:雲朵君在本文中,重點介紹特徵選擇方法基於評估機器學習模型的特徵重要性在各種不可解釋(黑盒)及可解釋機器學習方法上的表現。比較了CART、Optimal Trees

2021-06-30 16:35:14

來源:資料STUDIO

作者:雲朵君

在本文中,重點介紹特徵選擇方法基於評估機器學習模型的特徵重要性在各種不可解釋(黑盒)及可解釋機器學習方法上的表現。比較了CART、Optimal Trees、XGBoost和SHAP正確識別相關特徵子集的能力。

無論使用原生特徵重要性方法還是SHAP、 XGBoost都不能清晰地區分相關和不相關的特徵。而可解釋方法(interpretable methods)能夠正確有效地識別無關特徵,從而為特徵選擇提供了顯著的良好的效能。

特徵選擇

在物聯網的時代,每天都在以越來越快的速度創建和收集資料,這導致與每個資料點相關的資料集具有成千上萬的特徵。雖然眾多機器學習和人工智方法能都擁有強大的預測能力,但在這種高維資料集中,模型在理解各種特徵的相對質量時,也會變得很複雜。事實上,在訓練模型時並不需要用到所有的高維資料集,而運用其中一小部分特徵來訓練模型也可以得到大部分或所有的預測效能。

特徵選擇(feature selection)從所有的特徵中,選擇出意義的,對模型有幫助的特徵,以避免必須將所有特徵都匯入模型中去訓練的情況。

我們一般有四種方法可以選擇:過濾法、嵌入法、包裝法和降維法。其中包裝法和嵌入法都是依賴於依賴於演算法自身的選擇,即基於評估機器學習模型的特徵重要性,根據重要性分數了解哪些特徵與做出預測最相關的方法。這也是最常用的特徵選擇方法之一。

特徵選擇的重要性並不需要過多描述,因此由模型計算出的重要性分數能否反映實際情況是至關重要的。錯誤地高估不相關特徵的重要性會導致錯誤的發現,而低估相關特徵的重要性會導致我們丟棄重要的特徵,從而導致模型效能較差。

此外,像XGBoost這樣的黑盒模型提供了更加先進的預測效能,但人類並不容易理解其內在原理,因需要依賴於特徵重要性分數或SHAP之類的可解釋性方法來研究他們對特徵選擇的行為。

基於評估器計算特徵重要性原理

前面已經說過最常用的特徵選擇方法之一是基於評估機器學習模型的特徵重要性,而評估機器學習模型試圖量化每個特徵的相對重要性,以預測目標變數。特徵重要性的計算方式是通過度量模型中每個特性的使用所帶來的效能增量改進來,並在整個模型中總結這些資訊。我們可以使用它來識別那些被認為很少或不重要的特性,並將它們從模型中刪除。

不足之處:任何特徵選擇的方法只有在它也是準確的時候才有用。

CART樹特徵選擇的優缺點

基於樹的模型是機器學習中最常用的方法之一,因為它們的能力和可解釋性。CART等單樹模型是完全可解釋的,因為可以很容易地通過觀察最終決策樹中的分割來遵循它們的預測邏輯。

然而,CART是使用每次形成一個分割的樹的貪婪啟發式方法進行訓練模型的,這種方法會產生許多缺點。

首先,這可能導致樹遠不是全局最優的,因為貪婪啟發式中任何給定點上的最佳分割,這已被證明在樹的未來生長環境中並不是最佳的選擇。

其次,由於CART演算法採用每一步都窮盡搜尋所有特徵來拆分選擇方法,所以傾向於選擇拆分點較多的特徵。由於特徵的選擇很可能會偏向那些具有大量唯一值的特徵,而貪婪演算法可能導致在樹根附近的被用於分割資料的特徵選擇錯誤,而這些特徵往往是最重要的。

基於樹的整合學習器

基於樹的整合方法,如隨機森林和梯度增強(如XGBoost),通過整合大量單樹模型的預測來改進CART的效能。這樣確實帶來了更為先進的效能,但犧牲了模型的可解釋性,因為人類幾乎不可能理解成百上千的樹模型之間的互動及其他行為。因此,通常需要依賴可變重要性方法來理解和解釋這些模型的工作機制。

這些模型在計算特徵重要性時,可能會存在一定的敏感性,尤其對具有很多潛在分裂點的特徵,及特徵中包含一些易形成偏倚問題的資料。

SHAP

SHAP是一種最新的方法,它統一了許多早期的方法,旨在解決整合樹模型中的偏倚問題,並使用博弈論方法來理解和解釋每個特性是如何驅動最終預測的。SHAP因為它的魯棒性和解決偏差問題,迅速被廣泛用於解釋黑箱模型和進行特徵選擇。

最優樹

如前所述,與整合方法相比,CART的預測效能較差,但整合方法被迫犧牲單個決策樹的可解釋性來實現較好的預測效能,這使得從業者不得不在效能和可解釋性之間進行選擇。

最優樹利用混合整數優化在單步構造全局最優決策樹。所得到的模型不僅保持了單個決策樹的可解釋性,又能達到黑盒模型一樣的高效能。

由於該方法考慮同時優化樹中的所有分割,而不是貪婪地一個一個地優化,我們可以預期分割選擇,不像CART那樣容易受到同樣的偏倚問題的影響。

對比結果

SHAP和XGBoost一直低估關鍵特徵的重要性,而將不相關的特徵賦予顯著的重要性,並且在較高的噪聲下無法完全區分相關與不相關的特徵。顯然這些不能被用於特徵選擇或解釋,否則這將會發生嚴重的後果。

另一方面,可解釋的單樹模型在識別與預測無關的特徵方面優勢突出,在需要相對較少的訓練資料的情況下將其重要性降至零。

相對於CART樹,最優樹注重全局優化,因而其識別無關特徵的速度更快以及對特徵選擇的偏倚問題的敏感性更低。

可解釋的單樹模型在消除無關特徵方面是完全透明和有效的;在使用最優樹時,通常以很少甚至沒有效能代價就能完成消除無關特徵。

相關文章

來源:資料STUDIO作者:雲朵君在本文中,重點介紹特徵選擇方法基於評估機器學習模型的特徵重要性在各種不可解釋(黑盒)及可解釋機器學習方法上的表現。比較了CART、Optimal Trees

2021-06-30 16:35:14

週二世界行動通訊大會(MWC)上,馬斯克高調錶示,在接下來的一年,星鏈使用者可能會超過50萬。自2018年以來,星鏈網路已經向近地軌道發射了1700多顆衛星,已經擁有超過69420位活躍使用者

2021-06-30 16:34:56

列舉從資訊學競賽(OI)或清華計算機系走出來的牛人,人們總會提到鬲融的名字。 這位來自河北唐山的青年,因2004年與樓天城、胡偉棟、慄師代表中國參加第 16 屆國際資訊學競賽(IOI)、

2021-06-30 16:13:53

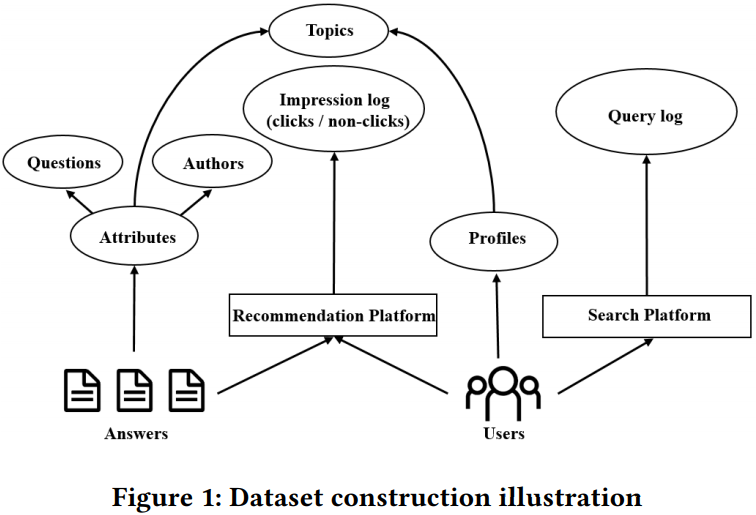

機器之心專欄知乎、清華大學知乎聯合清華大學對外開放基於知乎的大規模富文字查詢和推薦資料集「ZhihuRec」。該資料集包含了知乎上的 1 億個行為資料,是目前為止,國內用於個

2021-06-30 16:13:37

2021年6月,榮耀推出了它的全新產品,榮耀50系列手機。這一次榮耀的數字系列沉澱了一年之久,以體驗至上的姿態迎接每一位使用者,它在各方面的效能表現也沒有讓人失望,甚至有

2021-06-30 16:12:53

蘋果訂單迴流,值得慶祝?往外運輸材料費用不斷增加,再加上在印建廠不順利,招聘新員工、管理等方面都出了問題,富士康不堪壓力還是回國再招聘新員工為產線加能趕工期。蘋果呢?此前庫

2021-06-30 16:12:44