夢晨 發自 凹非寺量子位 報道 | 公眾號 QbitAI來自清華的研究團隊釋出了一段視訊:兩人打球的動作精準又流暢地被右下角的膝上型電腦捕捉到。但是房間裡沒看到攝像頭,兩人身上

2021-06-07 17:19:32

夢晨 發自 凹非寺量子位 報道 | 公眾號 QbitAI

來自清華的研究團隊釋出了一段視訊:

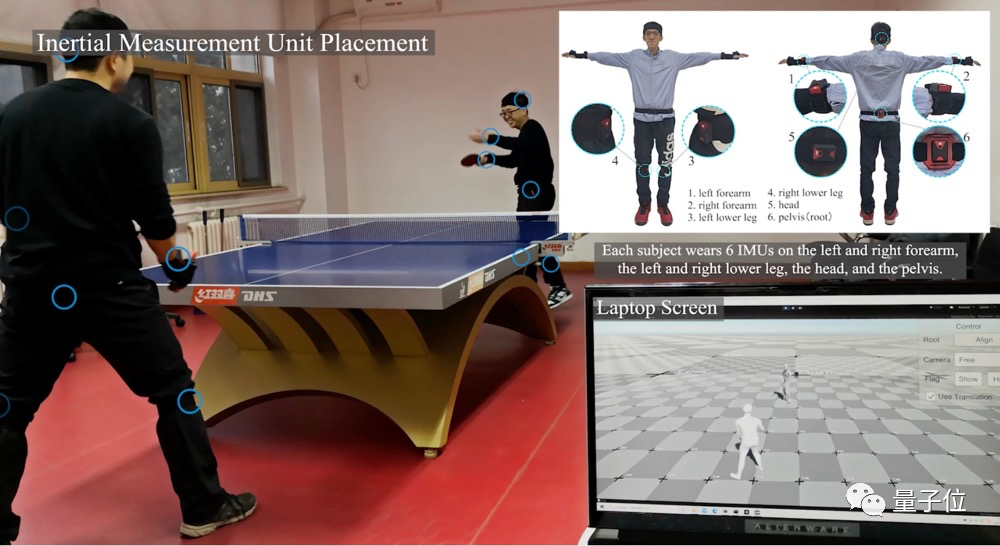

兩人打球的動作精準又流暢地被右下角的膝上型電腦捕捉到。

但是房間裡沒看到攝像頭,兩人身上也好像沒穿戴什麼裝備?

印象中的全身3D動捕的一套裝備和場地佈置,可是這樣的:

△光學動捕,《最後生還者》拍攝現場

△光學動捕,《最後生還者》拍攝現場或是這樣的:

△慣性動捕

△慣性動捕最輕便的也得有5、6斤,價格便宜的就更重了能達到10幾斤。穿在身上影響動作的靈活性,而且很快就會累了,基本無法日常使用。

視訊中的裝備,後面標記出來才看到,兩人身上各自只戴了6個小型慣性感測器,還是無線的。

現在市面上的VR裝置主要用的是光學動作捕捉。

要知道VR剛出來那會不管有線無線,最大的障礙是要在房間周圍擺上3到6個柱子。

後來簡化成了頭戴裝置上的攝像頭向外掃描周圍的環境實現定位,加上兩個手柄上的慣性感測器,如PSVR。

但動作捕捉的範圍就只能是以頭部和手部為主,腿部動作一直是難題。移動只能在畫面裡前進,並不能將腿部的具體動作在遊戲中表現出來。

《半條命:Alyx》中的移動方式

《半條命:Alyx》中的移動方式或者健身環,簡單地檢測到你在擡腿,再模擬成遊戲中固定的腿部動畫,或借用遊戲中的交通工具。

而現在,清華大學的新方法,可以實時捕捉跳躍和蹲爬,幀數都是90fps:

跨越障礙,甚至是躺下打滾都沒問題:

除了能跟蹤人體的全身動作,還能實現在空間上的定位。由於不需要固定的感測器,長距離移動也沒問題。

與光學動捕相比,慣性動捕還有兩個好處。

一個是不怕環境障礙物遮擋。第二個是對照明環境沒有要求,夜間也可以。

除了個人VR遊戲外,新的慣性動捕技術還可能降低商業動作捕捉的成本,讓小規模的製作團隊也有機會用上。

在遊戲和動畫電影中,動作捕捉攝影棚是這樣的:

這恐怕只有大公司才承擔得起了。

除了娛樂外,動作捕捉技術在醫療領域也有應用,可以用資料指導傷者更好地進行康復訓練。

雙向迴圈神經網路

這麼好的方法是怎麼實現的呢?原來是靠深度學習。

研究團隊分階段將動作捕捉拆成3個子任務。先從慣性資料算出5個主要節點頭部和四肢的位置,再細化成全部23個節點的位置,最後通過反向動力學(IK)求解。

由於預測連續的動作不僅要依賴前面的計算結果,還要參考後面一層的結果。所以在這一步用到的是雙向迴圈神經網路(biRNN)。

在空間定位問題也是拆成兩部分。一個是腳與地面接觸的概率分佈,再結合根結點的速度,算出在世界座標的速度,同樣用到RNN與biRNN。

對於不同的任務使用不同的公開資料集進行訓練,包含300名受試者超過40小時的姿勢和空間位置參數。

與之前的研究相比,任務拆解的方法有助於用更少資源獲得更高幀數,可以勝任高速運動的捕捉。

並且實現了動作捕捉的同時進行空間定位。

不過,還是有兩點不足。一個是動作捕捉的效果依賴於訓練資料集,對訓練集中沒有的動作效果就一般。

還有在計算腳與地面的接觸概率分佈時,假定了接觸時腳是固定不動的,不能適用於滑板等運動。

作者團隊

本項目論文已被計算機圖形頂會SIGGRAPH 2021接受。

研究團隊來自清華大學北京資訊科學與技術國家研究中心和軟體學院。

徐楓團隊副教授團隊,第一作者伊昕宇。

項目地址:https://xinyu-yi.github.io/TransPose/

論文地址:https://arxiv.org/abs/2105.04605

相關文章

夢晨 發自 凹非寺量子位 報道 | 公眾號 QbitAI來自清華的研究團隊釋出了一段視訊:兩人打球的動作精準又流暢地被右下角的膝上型電腦捕捉到。但是房間裡沒看到攝像頭,兩人身上

2021-06-07 17:19:32

6月2日,在萬眾矚目之下,華為鴻蒙系統HarmonyOS 2面向全球正式釋出。這個屬於中國人自己的手機作業系統,準確來說是包括手機在內的「智慧終端」作業系統,一經發布便讓整個科技行

2021-06-07 17:18:40

武漢,千古九州通衢要衝,黃鶴樓看長江東去,更有武昌首義直到庚子抗疫的悠久英雄傳統,也是iGame GeForce與NVIDIA的粉絲重鎮。因此,2021年的iGame &NVIDIA粉絲嘉年華選擇在武漢

2021-06-07 16:58:24

追風者(Phanteks)宣佈Glacier One系列將推出全白色的Glacier One 360MPH一體式水冷散熱器,與原版產品相比,從冷排本體、散熱風扇、導液管到水冷頭等,全部改成了白色,很適合構建白

2021-06-07 16:56:49

轉眼間,2021年又走到了中旬,各大電商平臺早已磨拳擦掌,一場浩浩蕩蕩的年中大促季已經拉開帷幕。作為超愛買買買的「剁手黨」,當然不可能讓這般盛大的促銷季白白溜走,那麼今年年中

2021-06-07 16:56:31

根據媒體6月4日的報道,高通正在研發一款新的處理器,代號為SM8450。據筆者瞭解,驍龍888的代號為SM8350,因此從代號來看,高通這款新的處理器,很有可能是驍龍888的繼任者,以下暫稱為「

2021-06-07 16:56:18