機器之心專欄作者:常清中國科學院自動化研究所智慧感知與計算研究中心聯合華為等企業提出面向行業的視覺物體檢測一站式解決方案 GAIA。在深度學習與大資料的浪潮下,視覺目標

2021-07-09 03:04:25

機器之心專欄

作者:常清

中國科學院自動化研究所智慧感知與計算研究中心聯合華為等企業提出面向行業的視覺物體檢測一站式解決方案 GAIA。

在深度學習與大資料的浪潮下,視覺目標檢測在各個基準資料集上已經達到了優異的效能。中國科學院自動化研究所智慧感知與計算研究中心聯合華為等企業提出面向行業的視覺物體檢測一站式解決方案 GAIA。通過 GAIA,使用者可輕鬆獲得不同硬體環境下的可直接用於部署的目標檢測模型。GAIA 致力於構建一種生態,它以目標檢測為基礎,後續將會開枝散葉擴展到更多領域,期望更多的學者和使用者共同維護 GAIA 的迭代,參與到 GAIA 社群中。該研究的論文已被 CVPR 2021接收。

GAIA 應時而生

目標檢測是識別圖片中有哪些物體以及物體的位置(座標位置)的技術,是計算機視覺應用的基礎,比如例項分割、人體關鍵點提取、人臉識別等。在網際網路、大資料、人工智慧等技術的發展浪潮下,目標檢測展現出巨大的應用價值,受到工業界、學術界的密切關注。各類研究機構爭相構建並對外公開 COCO、OpenImage 等大規模資料集用於目標檢測模型訓練。資料集的日益豐富極大促進了技術的更新迭代,不斷湧現出以 Faster R-CNN 為脈絡發展的 Two-stage 和以 YOLO、SSD 為基礎的 One-stage 目標檢測新正規化。

目標檢測技術在產業應用中的需求越來越廣泛和深入,學術界已經訓練好的模型評估都是基於標準 benchmark,在產業化應用落地中通常表現出嚴重的 「水土不服」,需要重新定製化開發。快速設計出最適合工業界不同業務場景的目標檢測模型是一項很有挑戰的工作,需要決定製化需求開發中的核心痛點問題:

一、資料整合難。資料治理是建模的基本要素,在 AI 應用開發過程中,從資料的採集、清洗和轉換到最終生成演算法所需的資料集需要經歷繁瑣的流程和花費高昂的成本,而且很有可能因為資料的準確性、完整性、有效性等問題,無法發揮模型優勢。

二、模型優化難。模型需有冗繁調參、預訓練過程才能發揮其效能。很多終端使用者由於沒有足夠相關專業領域知識,無法從紛繁複雜的模型及資料中選取最優資源。對個人使用者來說,計算資源不足導致訓練耗時過長,使得演算法調優更是雪上加霜。

三、資源共享難。不同使用者可能有類似的需求,但是他們都需要分別進行一系列從資料到模型的重複開發,模型遷移難度大,而且資源浪費嚴重。

四、模型定製難。針對不同的下游任務,往往需求千差萬別,資料各式各樣,算力各有不同,現在方法往往需要針對不同下游任務進行人工定製,費時費力。

為此提出了面向行業的視覺物體檢測一站式解決方案:視覺目標檢測大模型 GAIA(相關人員包括:張兆翔研究員、彭君然博士、卜興源、常清等)。該平臺適應移動終端、個人電腦、大型伺服器等任意場景,終端使用者只需要在 GAIA 配置檔案中設定檢測的類別,輸入簡單的幾行命令,GAIA 迅速響應,自主學習資料集選擇、模型選擇和超參數優化等過程,使用者可以輕鬆、快速獲得任意下游資料、任意耗時要求的自適應解決方案(圖 1)。

圖 1. GAIA - 面向行業的視覺物體檢測一站式解決方案

GAIA 詳解

視覺目標檢測大模型 GAIA 作為面向行業打造的下一代一站式目標檢測新方案,包含上游資料集、全模型訓練、稀疏資料下資料選取和部署模型提取四個模組。

圖 2. 視覺目標檢測大模型 GAIA 技術框架

上游資料集賦能

各類研究機構為不同的研究任務構建了各類目標檢測公開資料集,如 COCO、Object365、Open Images、Caltech、CityPersons、UODB 等都是主流的目標檢測資料集。學術界往往都是在上述標準資料集下進行檢測任務的訓練和測試,但是對產業界來講,如何從已有的資料集中選取適合應用場景的子集卻是舉步維艱。

借鑑大規模預訓練模型 BERT、GPT-3 等在自然語言處理領域中的成功,GAIA 將該正規化延拓到視覺目標檢測領域,對所有可用公開資料集整合並進行大規模預訓練,增加模型的泛化能力和表示能力。由於自然語言中語料資料集本身是離散型,自然語言處理中的大規模預訓練很容易構建無監督訓練任務。但是這種方法遷移至計算機視覺領域就會遇到很多瓶頸,不同資料集的類別標籤很容易出現歧義,比如像 earth、ground 可能在不同的資料集中都表示地面,或不同資料集類別標籤之間存在包含關係,像綠植和樹。GAIA 通過語義模型對類別建立語義相似度,將不同資料集中類別語義相似度大於閾值的歸為同一類別,從而梳理出最終的類別和 ID 的對映關係。

全模型訓練

神經網路架構搜尋演算法 OFA、BigNAS 等在訓練超網時,對其中的子網同時訓練,這樣只需花費很小的代價就可得到不需要微調就效能優異的子網路。與 BERT、GPT 等預訓練大模型相比,GAIA 不同之處在於將 NAS 與大規模預訓練進行結合,提供涵蓋各種 latency 下的高效能預訓練網路。設計良好的子網取樣空間對網路的訓練至關重要,在我們進行探索的過程中發現網路深度和輸入影象解析度是影響模型效能的核心因素,網路寬度是模型運行佔用視訊記憶體的關鍵因素(圖 3)。因此 GAIA 的取樣空間從網路深度、輸入解析度、網路寬度三個維度出發,根據已有的經典網路模型設定錨點,在錨點周圍空間從三個維度進行子網抽取,讓整個模型訓練過程更加有效。

圖 3. 模型效能分析

特定下游任務資料選取

使用者在本地下游任務中,能提供的有標籤資料十分有限,已有的開源資料集雖然包含的資料類別十分豐富,數量也十分龐大,但是相同類別的資料存在域間差異,比如漫畫圖片中的鳥和自然場景中的鳥存在很大差異,直接通過類別使用開源資料集,只會對使用者本地下游任務產生不利的影響,選取合適資料集,幫助下游任務是一項不小的挑戰。

如果終端使用者提供的有標籤資料數量沒有達到預先設定好的閾值,GAIA 會直接根據該使用的語義模型找到本地類別中語義資訊最近似的類別,在該類別的上游資料集上通過模型映射向量的相似度找到域間差異最小的一部分圖片(如圖 5),並對提取模型快速訓練。通過該功能,即使使用者只能夠提供幾張圖片的資料場景下,GAIA 同樣可以提供十分出色的模型。

圖 5. 特定任務資料選取

下游模型選擇

GAIA 已經測好所包含各種子網的 FLPOPS TABLE,以及多種硬體平臺下的 LATENCY TABLE(圖 6)。對於初級使用者而言,只需要在本地提供 FLPOPS、LATENCY 和硬體平臺,就可以獲得滿足這些約束的效能最佳的子網。對於經驗豐富的使用者,可通過 GAIA 提供的介面,自定義新增其他約束條件,輕鬆獲取效能優異的定製化子網模型

圖 6. 下游模型結構選取

優越效能

GAIA 的強大之處最直接體現在可以滿足使用者給出的任意時延或任意下游資料,快速定製可部署檢測模型,以 COCO 資料集為例,GAIA-det 可以快速提供時延 16~53ms、AP 38.2~46.2 的模型。使用者不需要再花費很大的精力從資料到模型重新開發。

GAIA 已經在 VOC、Object365、OpenImages、Caltech、KITTI 等 15 個目標檢測常用公開資料集上通過測試(圖 7),發現 GAIA 提供的模型可以很好的滿足終端使用者的定製需求。

圖 7. GAIA 在目標檢測常用資料集的效能對比

未來展望

視覺目標檢測大模型 GAIA 是面向行業的視覺物體檢測一站式解決方案,隨著應用場景的日益豐富和理論技術的突破,不斷更新的上游資料集會定期匯聚到 GAIA,新的訓練模型和網路架構都會通過測試驗證後迭代至 GAIA,確保 GAIA 一直為終端使用者提供最優質的行業解決方案。現階段,GAIA-det 已在 Github 上開源,GAIA-seg、GAIA-ssl 接近完成,即將推出,致力於解決更多領域的問題。。GAIA 是我們大家共同的 GAIA,GAIA 需要大家的寶貴意見和建議,期望更多的學者和使用者共同維護 GAIA 的迭代,參與到 GAIA 生態建設中,一起讓 GAIA 成長得更快更好。

相關文章

機器之心專欄作者:常清中國科學院自動化研究所智慧感知與計算研究中心聯合華為等企業提出面向行業的視覺物體檢測一站式解決方案 GAIA。在深度學習與大資料的浪潮下,視覺目標

2021-07-09 03:04:25

博雯 發自 凹非寺量子位 報道 | 公眾號 QbitAI機器會怎樣來看世界?通過幀。傳統的影象感測器會通過每秒捕獲多張靜止影象來記錄場景運動。如果將這一系列影象通過足夠快的速

2021-07-09 03:03:32

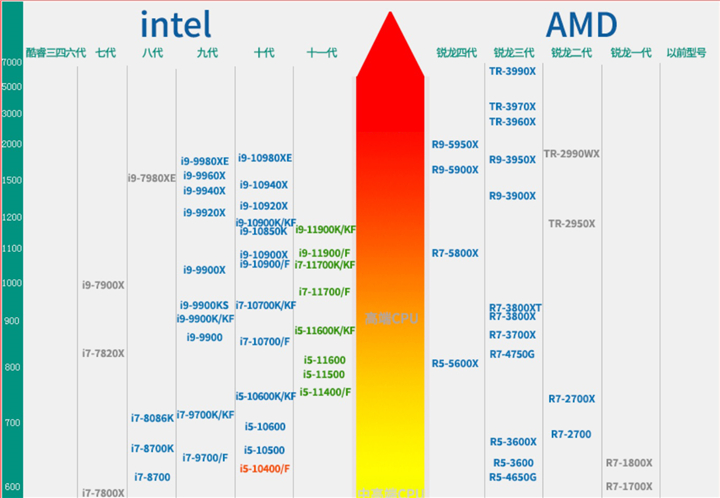

膝上型電腦CPU天梯圖,膝上型電腦CPU排行,是按照CPU的跑分進行排序,進行綜合性能對比。可以一定程度上反應CPU的效能優劣,方便進行膝上型電腦CPU對比。 2019年的CPU天梯圖,基本

2021-07-09 03:03:23

第一款 OLED iPad據供應鏈訊息指出,蘋果將會在 2023 年釋出新一代設計的 iPad Air 產品,而在此之前,iPad Air 都只會是小的例行更新。從供貨安排來看,新款 iPad Air 2023 款將會

2021-07-09 03:03:06

摩托羅拉曾經是全球銷量非常好的手機廠商,在安卓前時代,有些機型銷量甚至超過1億部,不過自從被聯想收購後,摩托羅拉沒有以前的輝煌了,如果沒有被聯想收購,摩托羅拉會不會更好,這個

2021-07-09 03:03:00

說到快充,很多人都已經不陌生了,無論是手機、平板還是筆記本甚至Switch,幾乎所有智慧裝置都已經支援快充,我們也都體驗到了快充帶來的便捷。但是也有不少人困惑,不同充電器上的介

2021-07-09 03:02:40