選自Facebook AI Blog作者:John Pavlus機器之心編譯機器之心編輯部Facebook、普林斯頓大學和 MIT 的 AI 研究人員近日聯合出版了一份名為《The Principles of Deep Learning

2021-08-05 12:14:37

選自Facebook AI Blog 作者:John Pavlus 機器之心編譯 機器之心編輯部 蒸汽機推動了工業革命的發生,並改變了製造業。然而,直到熱力學定律和統計力學原理的發展,科學家們才能夠在理論層面完全解釋蒸汽機的工作原理。 當然,缺乏理論知識並不能阻止人們對蒸汽機的改進,但是有了理論的指導為基礎,技術的發展將會更快。當科學家們最終掌握了統計力學時,其影響遠遠超出了製造更好、更高效的引擎。統計力學使人們認識到物質是由原子構成的,預示著量子力學的發展,如果從整體上看,這甚至促進了為計算機提供動力的電晶體的發展。 今天的人工智慧也處於類似的關頭。DNN(深度神經網路)是現代 AI 研究的重要組成部分,但它們的實現方式或多或少被視為「黑匣子」。雖然人工智慧從業者對 DNN 的理解取得了實質性進展,但 DNN 通常被認為太複雜而無法從基本原理來理解。模型主要通過反覆試錯進行微調——雖然試錯可以智慧地進行,通常是根據多年的經驗,但它是在沒有任何統一的理論語言來描述 DNN 及其功能的情況下進行的。 近日,來自 Facebook 人工智慧研究中心(FAIR)的科學家 Sho Yaida,麻省理工學院理論物理中心的研究員、Salesforce 的首席研究員 Dan Roberts 和普林斯頓的 Boris Hanin 合作,撰寫了一本關於如何從「第一性原理」來理解 DNN 的書籍《The Principles of Deep Learning Theory: An Effective Theory Approach to Understanding Neural Networks》。該書將於 2022 年初由劍橋大學出版社出版,手稿現在已經公開。 書籍地址:https://arxiv.org/pdf/2106.10165.pdf 「第一性原理」理解 DNN 首先我們來簡單瞭解一下什麼是「第一性原理」? 「第一性原理」指的是迴歸事物最基本的條件,將其拆分成各要素進行解構分析,從而找到實現目標最優路徑的方法。 最早提出第一性原理思維的人是亞里士多德,他把它定義為「認知事物的第一基礎。」 許多偉大的思想家,包括髮明家都使用了第一性原理的思考方法,但是沒有人比企業家伊隆 · 馬斯克更有效地深入思考第一性原理。這個詞的出圈也得益於馬斯克的助推。他曾在採訪中提到自己特別推崇第一性原理思考法。 書籍作者也是從「第一性原理」來理解 DNN 的。 書籍長達 451 頁,開篇引用了量子力學的奠基人、諾貝爾物理學獎得主狄拉克在《量子力學原理》一書序言中的一句話:「這就需要完全脫離歷史發展路線,但這種突破是一種優勢,因為它使人們能夠儘可能直接地接近新的思想。」 在基本層面上,該書提供了一個理論框架,從「第一性原理」理解 DNN。對於人工智慧從業者來說,這種理解可以顯著減少訓練 DNN 所需的試錯量。例如,該理論框架可以揭示任何給定模型的最佳超參數,而無需經過當今所需的時間和計算密集型實驗。 「該書提出了一種具有吸引力的方法,基於理論物理學中熟悉的擴展來進行機器學習,」斯坦福大學物理學教授 Eva Silverstein 表示道。「這些方法在理解和改進人工智慧方面可以帶來多大的進步,將是令人興奮的。」 Facebook VP 兼首席 AI 科學家 Yann LeCun 也在推特上推薦該書,並表示「在科學技術發展史上,工程相關的往往排在第一位:望遠鏡、蒸汽機、數字通訊。解釋其功能和侷限性的理論往往出現得較晚:折射定律、熱力學和資訊理論。」「隨著深度學習的出現,人工智慧驅動的工程奇蹟已經進入我們的生活——但我們對深度學習的力量和侷限性的理論理解仍然是片面的。這是最早致力於深度學習理論的書籍之一,並以連貫的方式列出了近期理論方法和結果。」 這只是重塑人工智慧科學這一更大項目的第一步,這一項目既源自「第一性原理」,又側重於描述現實模型如何工作。如果成功,這種關於深度學習的一般理論可能會使人工智慧模型更加強大,甚至可以指導研究人員建立一個研究智慧普遍方面的框架。 相互作用的神經元 到目前為止,試圖理解 DNN 的理論家們通常依賴於網路的理想化,即所謂的「無限寬度限制」,在這種限制下,DNN 的每一層都有無限數量的神經元。 這類似於理想氣體定律與真實氣體情況。「無限寬度限制」為理論分析提供了一個起點,但它通常與現實世界的深度學習模型幾乎沒有什麼相似之處,尤其是普通的深度神經網路,在那種情況下,抽象將越來越偏離準確的描述。雖然偶爾有用,但「無限寬度限制」過於簡單,忽略了真正 DNN 的關鍵特性,而這些被忽略掉的特性可能就是讓 DNN 如此強大的有力工具。 如果從物理學家的角度來處理這個問題,核心是通過在「有限寬度」上建立一個有效的 DNN 理論,從而改進這個無限寬度限制。傳統上,物理學家的目標是創造最簡單和最理想的模型,同時也包含了描述現實世界所需的最小複雜性。在這裡,這需要取消無限寬度限制,並系統地納入所有必要的修正,以解釋有限寬度的影響。在物理學語言中,這意味著對單層和跨層神經元之間的微小相互作用進行建模。 這些聽起來像是小的改變,但是現有的玩具模型(toy models)和書中描述的模型在性質上是不同的。想象兩個檯球朝著對方前進。如果你用一個類似於無限寬度限制的非互動模型來計算即將發生的事情,你會發現這些球互相穿過,繼續朝著同一個方向運動。 但事實顯然不是這樣。球中的電子不能佔據同一個空間,所以它們會相互作用碰撞彈跳。 這些互動作用在現實生活中很重要,在物理學中也很重要,對 DNN 來說同樣如此。 考慮到神經元之間的類似互動作用,該書的理論發現了 DNN 的真正威力——它們從資料中學習世界表徵的能力——與其縱橫比(即深度與寬度之比)成正比。對於無限寬度模型,該比率為零,因此這些玩具模型無法捕捉深度,並且隨著 DNN 深度的增加,它們的描述變得越來越不準確。相比之下,使用有限寬度層,有效理論(effective theory)實際上會影響深度——這對於表徵學習和 DNN 的 D (深度)真正重要的其他應用至關重要。 麻省理工學院物理學副教授、NSF AI 人工智慧與基礎互動研究所所長 Jesse Thaler 說:「在物理學中,有效場論是理解粒子複雜相互作用的一種嚴謹而系統的方法。令人興奮的是,一個類似的、嚴謹的、系統的方法適用於理解深層網路的動態。在這些發展的啟發下,我期待著物理學界和人工智慧界進行更有成效的對話。」 雖然本書中描述的框架可以擴展到現代人工智慧社群使用的真實世界的 DNN,併為此提供了藍圖,但該書主要側重於用於教學目的、最簡單的深度學習模型(深度多層感知器) 。 應用於這種最簡單的結構,可以系統地求解有效理論方程。這意味著我們可以對 DNN 在整個訓練軌跡中的行為有一個第一性原理理解。特別地,我們可以明確地寫下一個完全訓練的 DNN 所計算的函數,來對新的測試例子做出預測。 藉助這一新的有效理論,研究者希望理論家們能夠推動對神經網路更深入、更全面的理解。雖然還有很多東西需要計算,但這項工作可能使該領域更接近於瞭解這些模型的哪些特定屬性使它們能夠智慧地執行。 研究者還希望這本書能夠幫助 AI 社群減少試錯週期,這些試錯有時會限制當前研究進展。研究者希望也能幫助 AI 從業者快速設計更好的模型——更高效、效能更好、訓練更快,或者所有這些。特別地,設計 DNN 的研究者能夠在沒有任何訓練的情況下選擇最優的超參數,並選擇最優的演算法和模型結構以獲得最佳的結果。 多年來,許多人認為這些問題永遠無法得到回答或解釋。該書籍表明,人工智慧不是一門無法解釋的藝術,實用的人工智慧可以通過基本的科學原理來理解。 研究者希望這只是個開始,並將繼續這項研究,將理論框架擴展到其他模型架構並獲得新的結果。在更廣泛的層面上,研究者希望這本書能夠證明,理論能夠提供對真實模型的理解。 雖然近年來,實證結果將人工智慧推向了新的高度,但研究者堅信,以理論為基礎的實踐有助於加速人工智慧的研究,並有可能發現無法想象的新領域,就像統計力學在一個多世紀前引領資訊時代一樣。 作者簡介 Sho Yaida 為 Facebook 人工智慧研究中心(FAIR)的科學家,研究方向是將理論物理學方法應用於理解神經網路。他在斯坦福大學獲得博士學位,讀博期間主要研究了黑洞,後來在麻省理工學院和杜克大學做博士後時轉向了有關玻璃的物理學研究。 個人主頁:https://ai.facebook.com/people/sho-yaida/ Dan Roberts 為麻省理工學院理論物理中心的研究員、Salesforce 的首席研究員,同時還是美國國家科學基金會人工智慧與基礎互動研究所 (IAIFI) 的成員。研究方向集中於如何將理論物理學的工具和觀點應用到人工智慧中。 個人主頁:https://danintheory.com/ 此外,還包括研究合作者普林斯頓的 Boris Hanin,主要研究深度學習、概率等。 個人主頁:https://hanin.princeton.eduFacebook、普林斯頓大學和 MIT 的 AI 研究人員近日聯合出版了一份名為《The Principles of Deep Learning Theory: An Effective Theory Approach to Understanding Neural Networks(深度學習理論原理:理解神經網路的一種有效理論方法)》的研究手稿,用來解釋深度學習實際工作原理的理論。

相關文章

選自Facebook AI Blog作者:John Pavlus機器之心編譯機器之心編輯部Facebook、普林斯頓大學和 MIT 的 AI 研究人員近日聯合出版了一份名為《The Principles of Deep Learning

2021-08-05 12:14:37

明敏 發自 凹非寺量子位 報道 | 公眾號 QbitAI你沒看錯,Intel版的Mac Pro更新顯示卡配置了!蘋果此次為其新增了3個顯示卡模組:AMD Radeon Pro W6800X MPXAMD Radeon Pro W6800X

2021-08-05 12:14:31

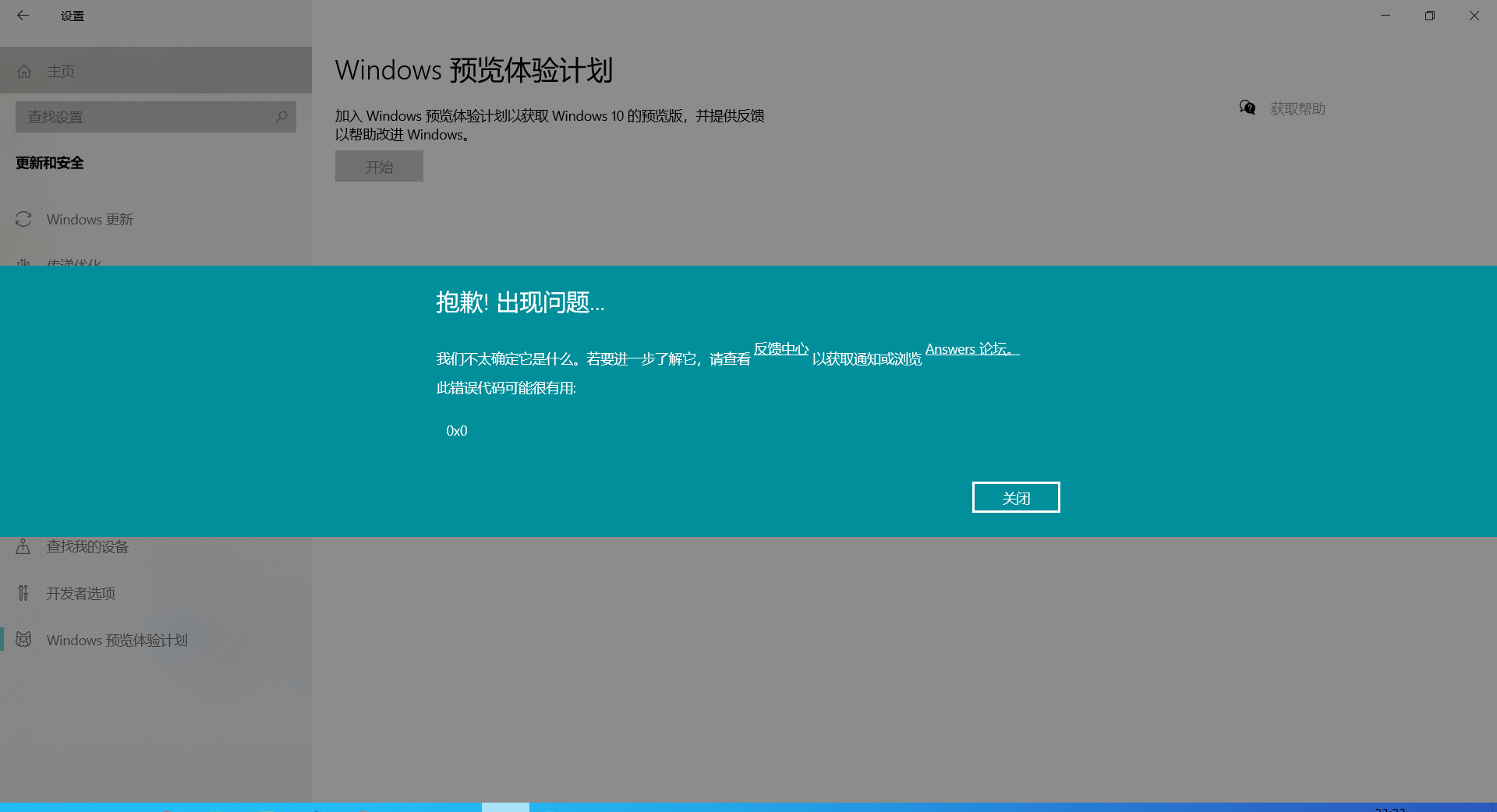

隨著Windows11系統的正式釋出,不少Win10電腦使用者都想要加入到Windows預覽體驗計劃中去升級到Windows11系統,但是不少使用者在加入的時候,卻顯示加入失敗錯誤程式碼0x0,那麼這

2021-08-05 12:14:23

對於遊戲,每個人都有著憧憬,小的時候,每個人都渴望遊戲,都希望可以玩到最好玩的遊戲,希望每個遊戲都能通關。長大後,遊戲人依然熱愛著遊戲,不過他們不再僅僅只是玩遊戲了,他們開始了

2021-08-05 12:14:09

把自己看成產品,給自己定個價。這也沒什麼可恥的,資本家企業家就是買我們的時間成本。一、別說謊別主動 好多認可能因為沒經驗或者避免尷尬,在談到有什麼問題問我的時候就開始

2021-08-05 12:13:43

位運算是很多演算法優化的基礎和實現的條件,極其重要。理解位運算對於一些演算法及其優化有著非常重要的意義。本篇隨筆講解位運算的一些基本原理和常用的使用技巧。基礎知識

2021-08-05 12:12:16