隨著科技的進步與發展,虛擬試衣間正在進入人們的生活。那麼如何為衣服、鞋子、配飾、手錶、眼鏡以及帽子提供虛擬試穿體驗,就需要了解虛擬試衣間的工作原理。為了讓消費者獲得

2021-06-07 10:24:07

隨著科技的進步與發展,虛擬試衣間正在進入人們的生活。那麼如何為衣服、鞋子、配飾、手錶、眼鏡以及帽子提供虛擬試穿體驗,就需要了解虛擬試衣間的工作原理。

為了讓消費者獲得在實體商店購物的體驗,從事虛擬試驗人工智慧技術開發的資料科學開發商MobiDev公司開發出一種虛擬試衣間。以下對虛擬試衣間技術的工作原理進行闡述和分析。

多年來,「先試後買」策略一直是服裝店行之有效的客戶互動方法。現在,這種策略能夠以虛擬試衣間的形式存在。根據調研機構《財富商業洞察》預測,到2027年,全球虛擬試衣間市場規模有望達到100億美元。

為了更好地理解虛擬試衣間技術的工作原理和技術邏輯,將以MobiDev公司近日開發的一個關於增強現實 (AR) 鞋類試衣間開發的項目為例。虛擬試衣間的工作方式如下:

將輸入視訊分割成幀,並用深度學習模型進行處理,該模型估計一組特定試衣者腿部和雙腳關鍵點的位置。

根據檢測到的關鍵點來放置鞋類的3D模型。

渲染3D鞋類模型,以便每個幀顯示逼真的紋理和光線。

MobiDev公司在使用ARKit(蘋果裝置的增強現實框架)時,發現它存在渲染限制。從釋出的視訊中可以看出,其跟蹤精度太低,無法用於鞋類定位。這種限制的原因可能是在忽略跟蹤精度的同時保持推理速度,這對於實時工作的應用程式可能至關重要。

另一個問題是ARKit 演算法對身體部位的識別效果不佳。由於該演算法旨在識別試穿者整個身體,如果處理後的影象僅包含身體的一部分,它不會檢測任何關鍵點。這正是鞋類試衣間所面臨的情況,而演算法應該只處理試衣者的腿部。

其結論是,虛擬試衣間應用程式可能需要附加功能以及標準AR庫。因此,建議讓資料科學家參與開發自定義姿勢估計模型,該模型應該只檢測幀中一隻腳或雙腳的關鍵點並實時操作。

虛擬試衣間技術可以提供配飾、手錶、眼鏡、帽子、衣服等產品的試穿功能。以下了解這些解決方案中是如何在幕後工作的。

AR-Watches應用程式就是試戴虛擬手錶的一個很好的例子,它允許使用者試戴各種手錶。該解決方案基於ARTag技術,利用印在錶帶上的特定標記,將錶帶佩戴在使用者的手腕上以代替手錶,以便開始虛擬試戴手錶。計算機視覺演算法僅處理幀中可見的那些標記,並識別攝影頭相對於它們的位置。之後,需要正確渲染手錶3D影象,虛擬攝影頭應放置在同一位置。

總的來說,該技術有其侷限性。但是,如果它與業務用例相匹配,那麼創建要使用的正確3D影象並不困難。

Wanna Kicks和SneakerKit應用程式很好地展示了AR和深度學習技術如何應用於鞋類。

從技術上來說,這種解決方案利用了基於深度學習的足部姿態估計模型。該技術可用於全身3D姿態估計模型的特殊情況,該模型直接或通過將檢測到的2D關鍵點的位置推斷為3D座標,來估計3D維度中所選關鍵點的位置。

3D足部姿勢估計

一旦檢測到試穿者足部的3D關鍵點的位置,就可以用於創建足部的參數化3D模型,並根據參數化模型的幾何特性對鞋類3D模型進行定位和縮放。

在檢測到的足部參數化模型上定位鞋類的3D模型

與全身/面部姿態估計模型相比,足部姿態估計仍然存在一定的挑戰。主要問題是缺乏模型訓練所需的3D註釋資料。

但是,避免這一問題的最佳方法是使用合成數據,該資料假設渲染具有關鍵點的逼真3D足部模型並使用該資料訓練模型;或者使用攝影測量法,它假設從多個2D檢視重建3D場景,以減少需要標記的數量。

這種解決方案在技術方面要複雜得多。為了使其解決方案推出市場,需要收集足夠大的足部關鍵點資料集(使用合成數據、攝影測量或兩者的組合),訓練定製的姿態估計模型(即將結合足夠高的準確性和推理速度),測試其在各種條件下的穩健性並創建足部模型。從技術上來說,這是一箇中等複雜度的項目。

FittingBox公司和Ditto公司考慮將虛擬現實(AR)技術用於虛擬眼鏡試戴。使用者應該從虛擬目錄中選擇一款眼鏡然後戴上。

虛擬眼鏡試戴和鏡片模擬

該解決方案基於深度學習的姿態估計方法,用於面部標誌點檢測,其中通用註釋格式包括68個2D/3D面部標誌點。這種註釋格式允許以足夠的準確度區分面部輪廓、鼻子、眼睛、眉毛和嘴脣。用於訓練人臉標誌估計模型的資料可能取自FaceAlignment等開源庫,提供開箱即用的人臉姿勢估計功能。

從技術的角度來看,這種解決方案並不複雜,尤其是如果使用任何預先訓練的模型作為人臉識別任務的基礎。但重要的是要考慮到低質量的攝像頭和光線條件差可能是限制因素。

在冠狀病毒持續蔓延期間,ZapWorks公司推出了基於AR的教育應用程式,旨在指導使用者如何正確佩戴醫用口罩。從技術上來說,該應用程式也是基於3D 面部標誌檢測方法。與試戴眼鏡應用程式一樣,這種方法允許接收有關面部特徵的資訊和進一步的蒙版渲染。

鑑於面部標誌檢測模型運行良好,另一個經常模擬的AR項目是帽子。正確渲染戴在頭上的帽子所需的一切就是幾個關鍵點的3D座標,這些關鍵點指示太陽穴和前額中心的位置。而QUYTECH、Banuba和Vertebrae等公司已經推出了虛擬帽子試戴應用程式。

與鞋子、帽子、眼鏡和手錶相比,虛擬試穿3D衣服仍然是一個挑戰。原因是服裝由於質地柔軟會變形。因此,為了獲得正確的AR體驗,深度學習模型不僅要識別人體關節上的基本關鍵點,還要識別3D身體形狀。

以深度學習模型DensePose為例,它旨在將一個人體的RGB影象畫素對映到人體影象的3D表面,研究發現它仍然不太適合增強現實。DensePose的推理速度不適合於實時應用程式,人體網格檢測對三維服裝項目的擬合精度不夠。為了提高結果,需要收集更多的帶註釋的資料,這是一項耗費時間和資源的任務。

另一種方法是使用2D服裝項目和2D人物輪廓。Zeekit公司就是這麼做的,讓使用者可以將多種服裝類型(連衣裙、褲子、襯衫等)應用到他們的照片中。

嚴格來說,2D服裝影象傳輸的方法不能被視為增強現實,因為「現實」意味著實時操作,但它仍然可以提供不同尋常的沉浸式使用者體驗。其背後的技術包括生成對抗網路、人體姿勢估計和人體解析模型。2D服裝轉換演算法如下所示:

(1)識別影象中與身體各個部位相對應的區域。

(2)檢測已識別身體部位的位置。

(3)產生轉換衣服的扭曲影象。

(4)將扭曲影象應用於具有最少產生偽影的人物影象。

由於虛擬更衣室並沒有現成的預訓練模型,因此使用ACGPN模型對該領域進行了研究。其想法是在實踐中探索該模型的輸出,通過利用各種方法進行2D布料轉換。

該模型應用於約束條件下(訓練資料集樣本、VITON樣本)和無約束(任何環境)條件下的人物影象。此外,不僅通過在自定義人物影象上運行模型,而且還使用與訓練資料完全不同的自定義服裝影象來測試模型能力的限制。

以下是在研究期間收到的結果示例:

(1)使用原始資料和預處理模型複製MobiDev公司研究論文中描述的結果:

衣服更換成功(A1-A3)和不成功更換(B1-B3)。

結果:

B1——修補效果不佳。

B2——衣服重疊。

B3——邊緣缺陷。

(2)定製服裝在預設人物圖片中的應用:

使用定製衣服更換衣服。

結果:

A 行——無缺陷。

B行——需要糾正的一些缺陷。

C行——嚴重缺陷。

(3)將預設服裝應用於自定義人物影象

具有無約束環境的影象上的服裝更換輸出。

A行——邊緣缺陷(輕微)。

B行——掩飾錯誤(中等)。

C行——修復和遮蔽錯誤(嚴重)。

(4)定製服裝在定製人物形象中的應用:

用不受約束的環境和自定義服裝影象替換衣服。

結果:

A行——從模型中獲得的最佳結果。

B行—— 許多缺陷需要稽核。

C行——最扭曲的結果。

在分析輸出時,發現虛擬試衣仍然存在一定的侷限性。關鍵是訓練資料應該包含目標布料的配對影象,以及穿著服裝的人物。如果給出一個真實世界的業務場景,完成它可能具有挑戰性。而這個研究的其他要點是:

ACGPN模型在來自訓練資料集的人物影象上輸出相當好的結果,如果應用定製服裝項目也是如此的話。

當處理在不同光線、不同環境條件和不尋常姿勢中拍攝的人的影象時,模型不穩定。

用於將虛擬2D服裝影象傳輸到野外人物影象上的虛擬更衣室系統的技術尚未投入商業應用。但是如果條件是靜態的,則其預期結果會好得多。

阻礙更好模型開發的主要限制因素是缺乏在室外條件下捕獲人員的多樣化資料集。

總而言之,當前的虛擬試衣間非常適合與身體各個部位有關的項目,例如頭部、面部、足部和手臂。但是需要完全檢測、估計和修改人體的試穿項目,虛擬試衣間技術仍處於起步階段。然而,AR技術發展正在突飛猛進,最好的策略是進行調整並不斷嘗試。

相關文章

隨著科技的進步與發展,虛擬試衣間正在進入人們的生活。那麼如何為衣服、鞋子、配飾、手錶、眼鏡以及帽子提供虛擬試穿體驗,就需要了解虛擬試衣間的工作原理。為了讓消費者獲得

2021-06-07 10:24:07

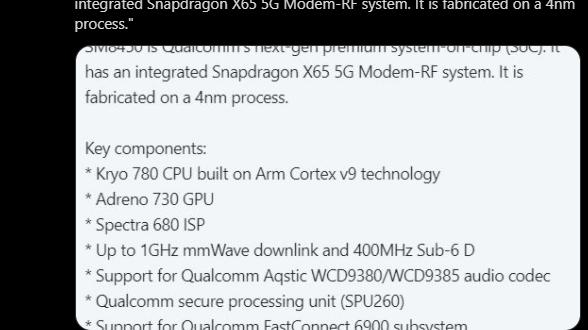

對於高通來說,目前在高階手機處理器市場擁有絕對的優勢,這是高通積年累月技術研發中取得的成功。因此,高通旗艦處理器在消費市場上也往往能夠獲得更多消費者的認可。根據最

2021-06-07 10:23:18

華為鴻蒙OS已經正式官宣,同時華為還發布了百機升級計劃,在華為釋出的百機升級計劃名單中,包含了35款可以升級鴻蒙OS的榮耀裝置。在這些支援升級鴻蒙OS的榮耀手機中,都是在榮耀獨

2021-06-07 10:23:01

6月1日,「京東618,18週年慶」喜迎開門紅,盛典開啟僅10分鐘,京東家電全渠道、各品類便呈井噴之勢,量額齊增,多點開花。作為開年首個大規模消費盛宴,京東家電踐行著全新品牌主張「煥

2021-06-07 10:22:22

嗨嘍,各位同學又到了公佈CDA資料分析師認證考試LEVEL II的模擬試題時間了,今天給大家帶來的是模擬試題(二)中的1-5題。不過,在出題前,要公佈上一期LEVEL II中146-150題的答案,大家

2021-06-07 10:21:46

5 月 25 日,華為 EMUI 官博正式更名 HarmonyOS,並宣佈釋出會定檔 6 月 2 日,在官方分享的開機畫面海報中,出現了顯眼的 Powered by HarmonyOS,「Powered by Android」正式成為歷

2021-06-07 10:20:33