博雯 發自 凹非寺量子位 報道 | 公眾號 QbitAI多麼「平平無奇」的一個換臉視訊:DeepFakes等一眾換臉神器對此紛紛表示:就這?但要是從網上的電影場景中,隨意抓一把人物影象丟進去

2021-06-16 17:19:34

博雯 發自 凹非寺量子位 報道 | 公眾號 QbitAI

多麼「平平無奇」的一個換臉視訊:

DeepFakes等一眾換臉神器對此紛紛表示:就這?

但要是從網上的電影場景中,隨意抓一把人物影象丟進去呢?

如果要換的這張臉正好在死亡角度,還做了個特別誇張的表情(或者乾脆就是個表情包)呢?

水就有點深了哈。

這時,由上交大和騰訊一起搞出來的換臉框架SimSwap表示:讓我來,我把握得住!

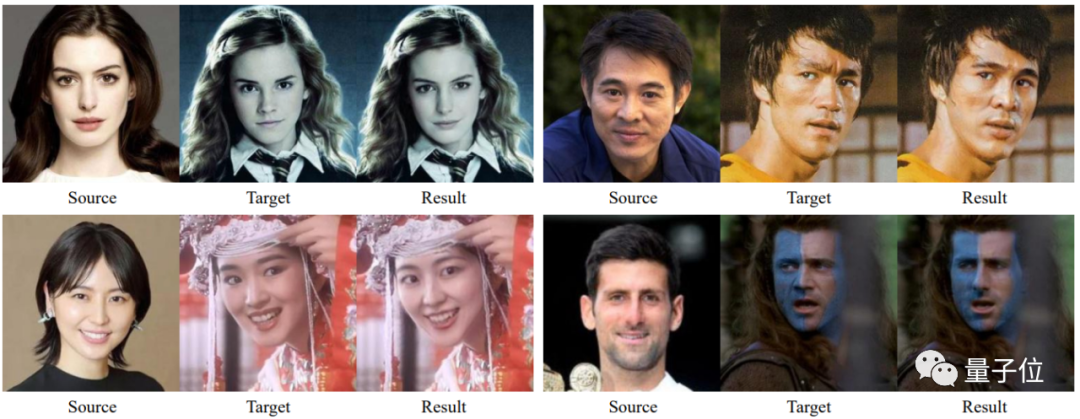

任意人臉都能換

一直身居換臉界C位的DeepFakes是怎麼換臉的呢?

對於同一人臉的大量圖片進行分析並提取特徵,然後將這種特徵替換到目標影象上。

這意味著什麼呢?我換一個新臉,就得訓練一個新模型。

但SimSwap提出了一種ID注入模組(IIM),在特徵層面將源臉的身份資訊遷移到目標臉,消除了原圖特徵資訊與解碼器的權重之間的相關性。

這樣,就將特定人臉互換演算法的結構擴展到了任意人臉互換框架。

也就像我們在開頭展示的那樣,不用精挑細選「正臉」或「中性表情,直接從網上抓一把人物圖片,也能夠完美換臉。

△所有的目標和原影象都被排除在訓練集

△所有的目標和原影象都被排除在訓練集這就大大節省了要反覆建立新模型的時間和金錢。

死亡角度、誇張表情也不怕

除了泛化到任意人臉變換之外,SimSwap也能更好地儲存原圖的臉部表情和角度。

不管是表情嘴巴嘟嘟,還是目標圖和原圖一側一正兩個角度,都能完美換臉。

就算是自下而上的死亡打光圖(下圖右邊第三行),SimSwap也表現得更好。

其實,像這種目標臉屬性(表情,姿勢,燈光)比較複雜情況下造成的特徵損失,一直是換臉面對的困難之一。

表情一誇張,或者處於極端角度和光線下時,就可能導致模糊和偽影。

這是因為在換臉任務中,常常要為了匹配原始特徵而刪除一些紋理資訊,進而使影象的深層特徵產生丟失。

此外,由於影象和它的屬性在特徵層面高度耦合,對於特徵的直接修改也會造成影象屬性效能的下降。

而SimSwap提出了一種弱特徵匹配損失(Weak Feature Matching Loss),保證了輸入目標和生成結果在高語義水平上的一致,並使判別器在最後幾層計算特徵匹配項。

這樣,即使沒有對特定屬性做任何明確的約束,輸入影象的屬性也能被一種隱式的方式保留。

可以看到,雖然SimSwap在原特徵表現上稍微落後,但涉及到臉部姿態這種複雜屬性時,它的儲存能力更好。

團隊介紹

論文的兩位共同一作都來自上海交通大學。

而通訊作者倪冰冰為新加坡國立大學博士,現任上海交通大學電子系的特別研究員和博導,主要研究方向是計算機視覺和多媒體計算。

論文地址:

https://arxiv.org/abs/2106.06340

下載地址:

https://github.com/neuralchen/SimSwap

相關文章

博雯 發自 凹非寺量子位 報道 | 公眾號 QbitAI多麼「平平無奇」的一個換臉視訊:DeepFakes等一眾換臉神器對此紛紛表示:就這?但要是從網上的電影場景中,隨意抓一把人物影象丟進去

2021-06-16 17:19:34

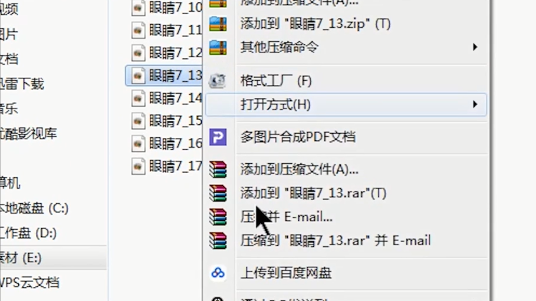

每個人都知道計算機檔案具有格式,例如JPG,MP3等,每種格式表示不同的檔案類型,那麼我們如何更改檔案類型的數量?讓我們來看看小編的解決方案。Win7批量更改複雜名稱後的檔案1.檢視

2021-06-16 17:19:23

iPadOS15 小特性雖然蘋果在 WWDC 上推出了全新的 iOS15 和 iPadOS15 等各大新版系統,但是介紹的內容並不多,很多功能被隱藏在系統中需要大家自己發掘。而在近日,使用者又發現了

2021-06-16 17:19:09

沒有雪糕的夏天是不完整的。想必你依然記得小時候常吃的雪糕,還是1-5元的價格。而現在回頭一看,雪糕價格早已步入10元以上的時代了。近年來備受年輕人喜愛的雪糕當屬網紅中式

2021-06-16 17:18:53

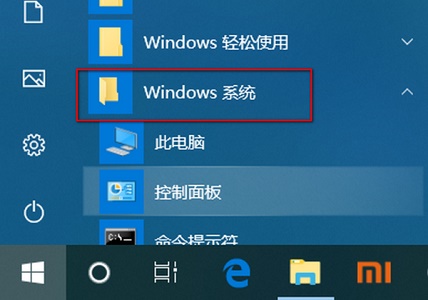

膝上型電腦通常具有F1-F12鍵的更多功能,具有FN功能鍵。但每個品牌的膝上型電腦接近路,那麼聯想膝上型電腦的功能鑰匙應該如何關閉?讓我們來看看如何用小編來解決它。聯想Win10

2021-06-16 17:18:48

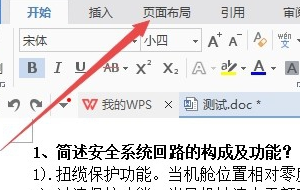

WPS訂購線在哪裡?當用戶完成整個WPS文件時,如果要編輯,則需要使用文件的訂單號,然後WPS訂購行在哪裡?讓我們來看看特定的操作設定。WPS訂單在哪裡?1.開啟編輯的測試檔案,然後單擊上

2021-06-16 17:18:35